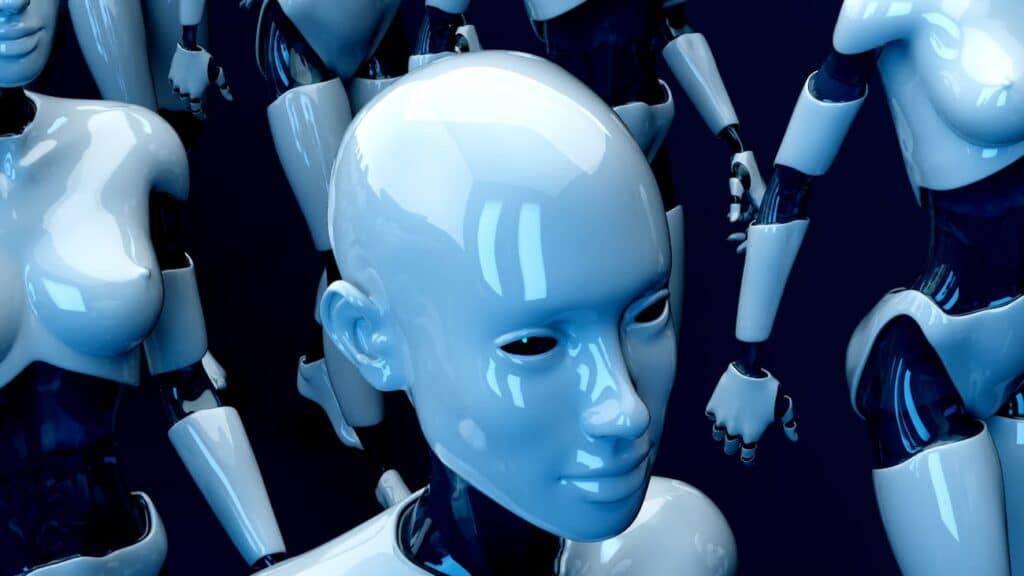

À Mountain View, en Californie, un vent d’optimisme souffle sur Google AI, le fameux Google Gemini. En effet, après des mois de turbulences et de critiques acerbes, Gemini, son modèle de langage phare, semble avoir enfin dompté les démons qui le hantaient. Les utilisateurs rapportent à ce jour une amélioration spectaculaire dans la génération de « personnes », ces entités virtuelles conçues pour interagir de manière si réaliste qu’elles en deviennent troublantes.

De la polémique à la rédemption

Il y a quelques mois à peine, Gemini était au centre d’une tempête médiatique. Des internautes avaient découvert avec effroi que le modèle pouvait créer des « personnes » aux comportements erratiques, voire carrément offensants. Le scandale avait éclaté, soulevant des questions fondamentales sur l’éthique de l’intelligence artificielle et forçant Google à mettre en pause certaines fonctionnalités de Gemini.

Aujourd’hui, le tableau est radicalement différent. Les témoignages enthousiastes affluent, décrivant les « personnes » générées par Gemini comme étant plus crédibles, plus cohérentes, et surtout, débarrassées des travers qui avaient provoqué tant d’émoi. « C’est comme un mauvais rêve qui s’achève », confie un développeur ayant eu accès à la nouvelle version. « On sent que Google a retroussé ses manches et a travaillé d’arrache-pied pour corriger le tir. »

Un tour dans les coulisses de la métamorphose

Bien que Google reste discret sur les détails techniques de cette transformation, les experts s’accordent à dire que l’entreprise a probablement mis les bouchées doubles, affinant les algorithmes de Gemini tout en renforçant la supervision humaine. « C’est un combat de tous les instants, qui exige une vigilance de chaque seconde », explique un chercheur en IA. Mais, les résultats sont là, et ils sont impressionnants.

On peut imaginer que Google a :

- Nourri Gemini avec des données de meilleure qualité, plus diversifiées et soigneusement triées pour éviter les biais et les contenus toxiques.

- Peaufiné ses algorithmes pour garantir une plus grande cohérence dans la génération de « personnes » et renforcer la détection des contenus inappropriés.

- Mis en place une supervision humaine plus rigoureuse, avec des équipes dédiées à l’évaluation de la qualité des sorties de Gemini et prêtes à intervenir en cas de dérapage.

L’IA sans erreur, une utopie ou une réalité à portée de main avec Google ?

La rédemption de Gemini pourrait bien marquer un tournant dans l’histoire de l’intelligence artificielle. Elle prouve qu’il est possible de créer des systèmes d’une puissance phénoménale tout en maîtrisant les enjeux éthiques. C’est une victoire éclatante pour Google, mais également pour toute la communauté de l’IA.

Google AI tire des leçons du passé et se projette vers un avenir visuel plus serein et responsable

Les progrès réalisés par Google AI pour améliorer Gemini sont indéniables. Cependant, Le défi est et demeure de taille. Tous s’accordent à dire que seule une utilisation à grande échelle, dans des contextes variés et imprévisibles, permettra de confirmer si Gemini a réellement intégré les leçons de ses déboires.

L’IA, par nature, apprend et évolue en fonction des données qu’elle traite. Si Gemini a été entraîné sur un corpus de données plus vaste et mieux filtré, il reste exposé aux biais et aux imprévus inhérents à toute interaction humaine. La vigilance reste donc de mise, et l’entreprise devra sans doute continuer à surveiller et à ajuster son modèle pour garantir qu’il reste sur la voie de l’éthique et de la responsabilité.

L’avenir de Gemini dépendra de sa capacité à maintenir sa fiabilité dans la durée, à s’adapter aux nouveaux contextes et à éviter de retomber dans les travers qui ont terni sa réputation.